Ziel & Zweck des Projekts

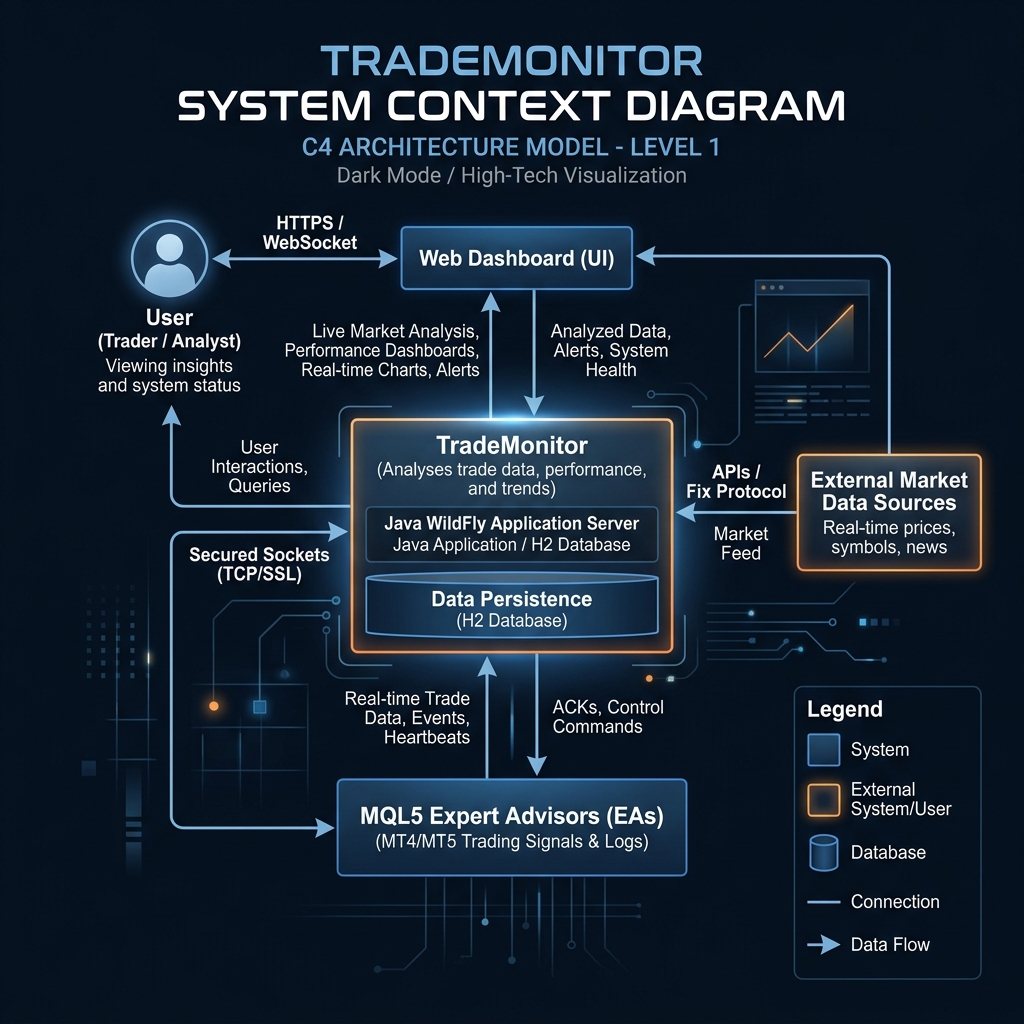

Warum dieser Showcase? IT-Architektur erfordert oft das Verständnis von Systemen, die tief in großen Organisationen verborgen liegen. Der TradeMonitor ist mein Beitrag, diese unsichtbare Komplexität transparent und visuell erlebbar zu machen. Das Projekt dient primär dazu, meine weitreichenden Fähigkeiten als Senior IT-Architekt und Full-Stack-Entwickler greifbar zu demonstrieren. Anstatt nur in theoretischen Konzepten zu sprechen, beweist dieses Projekt live in einer Contabo-Serverumgebung, dass ich komplette Systemlandschaften von der Datenbank über API-Schnittstellen bis zum responsiven UI designen, hochziehen und extrem sicher betreiben kann.

Demonstrierte Kernkompetenzen

Architecture & Design

- Entkoppelte REST-Microservices

- Saubere Schichtentrennung (MVC)

- Skalierbares Datenbank-Design

High-Performance Engineering

- Asynchrone Datenverarbeitung

- Serverseitiges Daten-Downsampling

- Millisekunden-Latenz Management

DevSecOps & Security

- Tiefgreifendes Log-Monitoring

- Infrastruktur-Hardening (Fail2Ban, UFW)

- CI/CD Pipeline Konfiguration

AI Orchestration

- Agent-Driven Development

- KI-gestützte Code-Generierung

- Architektonische Validierungsschleifen

Engineering Highlights: Was dieses Projekt auszeichnet

Ein gutes Showcase-Projekt grenzt sich durch die Lösung echter Nadelöhre ab. Hier sind zwei architektonische Highlights, die exemplarisch zeigen, wie ich Probleme in skalierenden Systemen systematisch und nachhaltig löse:

1. Das Big-Data Nadelöhr visualisieren (Server-Side Downsampling)

Problem: Das System schreibt minütlich Equity-Snapshots für jeden Trading-Bot in eine zentrale Datenbank. Über Wochen entstehen extrem große und granulare Datensätze. Ein naives Paging oder ein ungefilterter Export der JSON-Daten an den Client würde den Browser beim Rendern hunderttausender Punkte (die klassischen Zick-Zack-Charts in Chart.js) komplett überlasten und die Traffic-Kosten in die Höhe treiben.

Die Lösung: Anstatt das Problem mit Limits auf den User abzuwälzen, habe ich in der Java-Core-Engine einen maßgeschneiderten Downsampling-Algorithmus entwickelt. Er aggregiert die Ticks stündlich. Der Clou daran: Er bildet keine Durchschnitte (welche die harten Intraday-Abstürze glätten und verfälschen würden), sondern isoliert pro Intervall strikt den Sub-Tick mit dem Max Drawdown. So bleibt das wahre Trading-Risiko visuell und mathematisch zu 100% erhalten, während sich der API-Payload um über 98% reduziert. Das Ergebnis ist eine analytische Portfolio-Seite, die auch bei multiplen Konten in unter einer Sekunde sauber lädt.

2. Security-First & Self-Healing Infrastructure

Problem: Finanzdaten-Monitoring im offenen Netz bedarf einer lückenlosen und proaktiven Absicherung gegen Web-Crawler, Brute-Force-Attacken auf API-Endpunkte und DDoS-Wellen.

Die Lösung: Die gesamte Linux-Infrastruktur wurde kompromisslos gehärtet und verfügt über ein tiefgreifendes Log-Monitoring System. Der Java-Server prüft nicht nur seinen eigenen JVM-Status, sondern analysiert minütlich System-Logs (wie auth.log) auf Brute-Force-Patterns, checkt aktiv Fail2Ban-Jails, prüft UFW-Firewall-Settings und detektiert DDoS-Muster direkt in den Nginx-Logs. Sobald kritische Pattern erkannt werden, alarmiert das System proaktiv per Sirene ins Dashboard oder klassisch via E-Mail.

3. Präzise Drawdown-Metriken & Asynchrone Echtzeit-Analyik

Präzise Metriken vs Kontobewegungen: Um eine hochakkurate Performance-Kalkulation zu garantieren, wurde ein High Water Mark (HWM) Algorithmus integriert. Dieser separiert echte Trading-Drawdowns strikt von simplen Funding-Operationen. Investoren erhalten absolute Klarheit, verifiziert gegenüber historischen Kontostandsänderungen.

Die UI-Lösung: Kombiniert mit einem Zero-Latency Rendering greift das UI asynchron (Fetch API) und ressourcenschonend auf diese Daten zu. Eine milli-sekunden-genaue Copy-Trade Analyse mit Time-Shift Matching synchronisiert zudem Broker mit verschiedenen Zeitzonen. All dies gekapselt durch null-safe Architekturen, die das Frontend auch bei Teilausfällen stabil halten.

Praxisbeispiel: Die "denkende" KI als Security Analyst

Wie dieses moderne KI-gestützte DevSecOps in der Realität aussieht, zeigt ein aktueller Vorfall aus dem TradeMonitor-Labor – ein perfektes Beispiel für das Zusammenspiel von Mensch und Maschine:

Abbildung: Das Intrusion Detection System (IDS) schlägt Alarm bei unbekannten Netzwerkaktivitäten.

- 1. Die Detektion: Das eigens entwickelte Intrusion Detection System (IDS) registrierte bei einer Routineprüfung eine Konfigurationsänderung auf Systemebene. Ein unerwarteter Port (3003) war netzwerkweit offen. Das System reagierte vollautomatisch: Optischer Alarm im Dashboard (KRITISCH) und physische Aktivierung einer Warnsirene im Smart Home.

- 2. Die menschliche Intuition: Als Senior Architect und Systembetreiber hatte ich sofort eine Vermutung: Das kürzlich von mir implementierte KI-Chatbot-Backend könnte unbeabsichtigt einen Port geöffnet haben. Anstatt jedoch manuell über SSH auf dem Server Log-Dateien und Netzwerkkonfigurationen zu durchforsten, delegierte ich die Analyse-Aufgabe an meinen KI-Assistenten.

- 3. Die kognitive Analyse: Hier zeigt sich der immense Paradigmenwechsel. Die KI arbeitete nicht einfach ein vordefiniertes "Wenn-Dann"-Regelwerk ab. Da sie tief in den Entwicklungsprozess integriert ist und den Quellcode "kennt", führte sie in Sekundenbruchteilen eine kontextbasierte Analyse durch. Sie evaluierte die Node.js-Prozesse, glich diese mit der Nginx-Reverse-Proxy-Konfiguration ab und lieferte eine fundierte Diagnose: Es war kein Hackerangriff, sondern das neue Chat-Backend, das standardmäßig nicht an "Localhost" gebunden war und somit potenziell von außen erreichbar gewesen wäre.

- 4. Die Lösungsfindung: Die KI identifizierte nicht nur die Ursache, sondern generierte sofort den präzisen Fix: Eine Code-Anpassung, um den Dienst strikt an

127.0.0.1zu binden, womit die Sicherheitslücke auf Applikationsebene geschlossen wurde, gepaart mit einer proaktiven Aktualisierung der IDS-Whitelist. - 5. Der Executive Approval: Als menschlicher Security Analyst bewertete ich die Herleitung der KI, verifizierte die Lösung architektonisch und gab den Fix mit einem einzigen Klick frei.

Das Resümee einer neuen Ära

Wir befinden uns im Übergang zu einer völlig neuen Form der Softwareentwicklung. Es geht nicht mehr primär um das Schreiben von Code oder starre Skripte, sondern um "denkende" Systeme, die sich selbst überwachen, Anomalien erkennen und kontextsensitiv reagieren. Dieses Beispiel beweist eindrucksvoll, wie unfassbar effizient und hochsicher Infrastrukturen heute betrieben werden können, wenn man sie richtig orchestriert.

Gleichzeitig entstehen neue Angriffsvektoren – in einem künftigen Cyberwar gewinnt letztlich die intelligentere KI. Umso kritischer ist es, dass am Ende der Entscheidungskette weiterhin erfahrene Systemarchitekten stehen, welche die Blackbox der Maschine durchschauen, die vorgeschlagenen Lösungen auf Herz und Nieren prüfen und die finale architektonische Verantwortung tragen.

Technologie-Stack Overview

Warum Thomas Nickel? Der Architect-Pitch

Wir arbeiten in einer Phase des iterativen Wandels, in der KI-Agents Code-Module in Sekundenschnelle generieren. Doch eines ist unabdingbar: Fehlerfreie KI gibt es in komplexen Ökosystemen einfach nicht. Was nützt der schnellste Code-Generator, wenn die abstrakte Architektur fehlerhaft ist, relationale Datenbanken blockieren oder kritische Security-Lücken im Netzwerkdesign übersehen werden?

Hier beginnt mein unschätzbarer Vorteil als erfahrener System Architekt. Ich verfüge über über 25 Jahre Low-Level- und tiefgreifende Linux/Windows Systemerfahrung. Die KI liefert mir Entwürfe und standardisierte Bausteine – aber ich allein orchestriere den Bauplan. Ich erkenne Design-Flaws und Flaschenhälse, bevor sie produktionskritisch werden, konzipiere extrem ausfallsichere, skalierbare Datenstrukturen und garantiere mit meinem Stempel, dass das System am Ende hochgradig performant, sicher und vor allem von Menschen über Jahre hinweg wartbar bleibt.

Wenn Sie für Ihre nächste Position jemanden suchen, der nicht bloß Kanban-Tickets abarbeitet, sondern Verantwortung für den gesamten Lebenszyklus komplexer Enterprise-Lösungen übernimmt und dabei modernste KI-Tools als technologischen Hebel meisterlich einsetzt – dann freue ich mich sehr auf unser Gespräch!